Sora, novo modelo IA texto para vídeo (prompt-to-video)

Índice

ToggleSora é a novíssima ferramenta da OpenAI para criação de vídeo a partir de texto (prompt-to-video).

Depois do chatbot de Inteligência Artificial ChatGPT para texto e do Dall-E para a criação de imagens IA, o vídeo é a próxima fronteira.

Veja o que o Sora pode fazer, ainda em modo experimental.

Na batalha pelo domínio do mercado de vídeos criados por IA (Inteligência Artificial), a concorrência não é pouca!

O Image 2 da Google e o Make a Video da Meta.

Todas essas ferramentas estão em fase de testes rigorosos para garantir que os resultados sejam seguros e livres de conteúdo prejudicial.

No post de lançamento, a OpenAI escreve:

“Estamos a ensinar a inteligência artificial a compreender e simular o mundo físico em movimento, com o objetivo de treinar os modelos que ajudem as pessoas a resolver problemas que exijem interação com o mundo real”.

Ao anunciar o Sora, a OpenAI destacou a sua ambição em ensinar inteligências artificiais a compreender e simular o mundo físico em movimento.

Isso é fundamental para treinar modelos que possam resolver problemas que exigem interação com o mundo real.

Em seguida, vamos explorar mais sobre o que é o Sora, como funciona, a sua importância e aplicações.

O que é o Sora?

O Sora é um modelo IA (Inteligência Artificial) que transforma texto em vídeo.

Ou seja, uma ferramenta de criação de vídeo, capaz de criar cenas tanto realistas como imaginárias a partir de instruções de texto.

Com o Sora, os utilizadores podem criar vídeos fotorrealistas com a duração máxima de 60 segundos a partir de prompts (instruções) escritos.

A qualidade visual é impressionante e pode experimentar vídeos widescreen 1920x1080p e vídeos verticais 1080×1920.

Na nossa opinião os vídeos exibem clareza notável, movimento fluido e uma aderência impressionante à precisão anatômica.

A OpenAI destaca mesmo a capacidade de gerar cenas complexas, com múltiplas personagens, movimentos específicos e detalhes precisos tanto em indivíduos com no meio ambiente.

Entende como os objetos existem no mundo físico, interpreta adereços e cria “personagens convincentes com emoções” em vários cenários e temas, desde fantasia, ficção científica até terror e comédia.

Além disso, consegue adaptar-se às preferências do utilizador, como estilo cinematográfico, ajustes do brilho, cor e ângulo da câmara conforme indicações.

Outro aspeto notável é sua capacidade de criar um vídeo a partir de uma única imagem estática, bem como completar frames em falta num vídeo ou até mesmo aumentar a sua duração.

Para ver vídeos criados com a IA Sora visita a página oficial da OpenAI.

Como funciona o Sora?

Como mencionado anteriormente, o Sora é capaz de criar vídeos de até 60 segundos a partir de instruções em texto, com cenas complexas, personagens, movimentos específicos e detalhes precisos.

A própria OpenAI compartilha informações sobre como os vídeos são criados e como funciona o modelo generativo em dados de vídeo.

Assim como o GPT, o Sora utiliza uma arquitetura de transformação, com capacidade de escalar a resposta.

Ele também se baseia no treinamento com dados visuais do DALL·E.

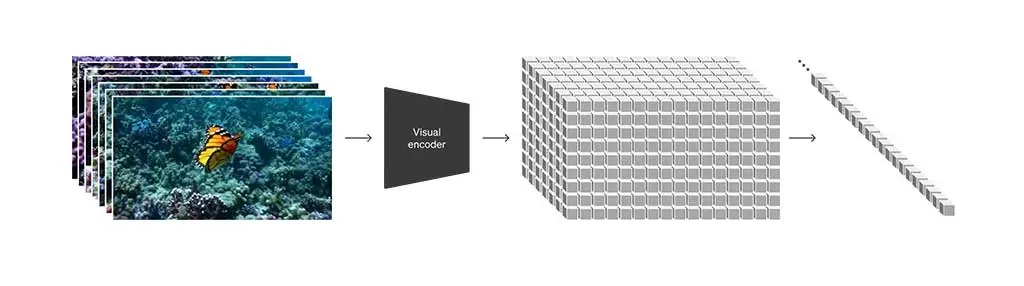

Enquanto os modelos de larga escala LLMs utilizam tokens de texto, o Sora utiliza patches visuais.

Os patches demonstram uma representação eficaz para modelos de dados visuais, que possibilitam uma representação altamente escalável e eficaz para treinar modelos generativos em diversos tipos de vídeos e imagens.

Tecnicamente transforma vídeos em patches, comprime-os em um espaço de dimensão inferior e, em seguida, decompõe a representação em fragmentos de espaço-tempo.

Para uma compreensão mais profunda desses aspectos técnicos e para ficar atualizado sobre todas as capacidades da ferramenta, é recomendado ler o relatório técnico da OpenAI.

No entanto, a OpenAI reconhece que o modelo atual tem suas fraquezas.

Ainda existem fragilidades nos resultados.

Por exemplo, o Sora nem sempre modela com precisão a física de muitas interações básicas, como a quebra de vidro.

Outras interações, como comer, nem sempre produz mudanças corretas no estado do objeto.

Além disso, o modelo pode confundir alguns detalhes de um prompt em relação às indicações espaciais e misturar a esquerda e a direita, ou compreender erroneamente alguns acontecimentos em uma linha do tempo sequencial.

Transforme as receitas do seu negócio

Entre em contato com a nossa Agência Marketing Gabriel e explore o potencial completo do seu negócio com as estratégias digitais:

SEO – Alavancamos o tráfego orgânico e conquistamos posições de destaque nos motores de busca.

Tráfego Pago – Desenvolvemos estratégias pagas altamente eficazes no Google Ads, Facebook Ads, Instagram Ads.

Inteligência Artificial – Utilizamos tecnologias avançadas para otimizar estratégias digitais.

Como usar o Sora?

Atualmente, a OpenAI ainda não divulgou informações sobre quando ou como lançará o Sora para o público em geral, nem qual será o modelo de preços e licenciamento adotado.

No entanto, assim como outras ferramentas de vídeo IA o utilizador tem a capacidade de produzir conteúdos audiovisuais a partir de prompts (instruções de texto).

Para usar o Sora, basta fornecer um prompt de texto a descrever a cena que deseja criar.

Quanto mais específico e detalhado for o prompt, melhores serão os resultados obtidos.

Os utilizadores podem especificar personagens, cenários, enquadramentos, estéticos, objetos em cena e até mesmo uma sequência de ações desejadas.

Após receber todas as informações do prompt, o Sora utilizará esses dados para criar um vídeo correspondente, às instruções especificas fornecidas.

Qual a importância do Sora e quais as suas aplicações?

O Sora não é o pioneiro no campo de vídeos gerados por IA (Inteligência Artificial).

Competidores como Runway, Pika Labs e Stability AI, que permitem a criação de vídeos IA com a duração de 4 a 15 segundos, já estão no mercado.

No entanto, a capacidade do Sora de criar vídeos de até 60 segundos estabelece um novo padrão na indústria.

Muitos especialistas acreditam que estas inovações têm um potencial de transformar uma série de indústrias criativas, desde o cinema, publicidade, design gráfico, desenvolvimento de jogos, entre outras áreas.

Além disso, setores como IA maketing, social media, marketing de influência e até tecnologia educacional podem se beneficiar significativamente do uso do Sora.

Estas novas tecnologias não apenas demonstra o poder da IA, mas também destacam o seu potencial na criação de experiências imersivas numa variedade de aplicações, desde entretenimento e educação até à publicidade e comunicação artística.

Algumas possíveis aplicações do Sora

O Sora abre um vasto leque de possibilidades principalmente para cineastas e contadores de histórias.

Funciona como um parceiro criativo, ao permitir visualizar as ideias e conceitos de longas-metragens, curtas-metragens, animações e documentários.

Para editores e produtores de vídeo, o Sora pode ser uma ferramenta transformadora.

Seja para aprimorar vídeos existentes, adicionar efeitos especiais, alterar cenários ou introduzir novos personagens, oferece recursos e criatividade ao processo de edição.

Na educação, o Sora pode ser bastante útil para os professores e alunos.

Transformar resumos de cursos em vídeos instrutivos, esclarecer conceitos científicos, eventos históricos ou culturais.

Facilita a criação e o acesso a informações envolventes, o que melhora a compreensão e a retenção dos conteúdos.

Utilizadores e influenciadores de redes sociais também podem encontrar no Sora um parceiro valioso na criação de vídeos personalizados.

Após a criação do vídeo, é possível editar e aprimorar ainda mais o conteúdo, face às expectativas e necessidades específicas.

Conclusão

Como observamos, junto com outras tecnologias, o Sora promete ser um avanço significativo no uso de IA generativa no campo audiovisual.

Como destacado pela OpenAI, o Sora representa um passo adiante no desenvolvimento de simuladores capazes de compreender e interagir com o mundo físico e digital, incluindo objetos, animais e pessoas.

Aqui na agência, acreditamos firmemente que os modelos de IA generativa no audiovisual, como o Sora, representam um salto incrível em direção ao desenvolvimento da AGI (Inteligência Artificial Geral).

Vimos ferramentas de conversão de texto em imagem, como Dall-E e Midjourney melhorarem dramaticamente nos últimos 18 meses, mas este serviço de prompt para vídeo representa um avanço muito maior.

Abre portas para produções que antes eram consideradas impossíveis e, ainda mais importante, acessível a todos.

Se você estiver interessado em acompanhar os desenvolvimentos dessa tecnologia e aprender como integrá-la ao seu negócio, subscreva a nossa newsletter marketing gabriel e seja o primeiro a receber informação privilegiada.

Esperamos que você considere esses recursos esclarecedores e inspiradores!

Se você gostou deste artigo, considere compartilhá-lo com seus amigos e deixar um comentário em baixo.

Agradecemos pela sua leitura e interesse!

Autor

Gabriel Cunha

Especialista em Marketing Digital, SEO e Anúncios Pagos na Agência de Marketing Digital & IA, que oferece serviços de marketing digital e de inteligência artificial altamente qualificados e equipas especializadas em estratégias e desenvolvimento de negócios.

Deixe um comentário